Er blijkt een methode te zijn om na te gaan of een afbeelding door AI gegenereerd werd. Opvallend is dat de methode al ingezet wordt voor wetenschappelijk onderzoek naar de ruimte.

Door technologische vooruitgang is het bijna onmogelijk geworden om AI-gegeneerde beelden te herkennen. Deepfakes, waarin afbeeldingen worden gegeneerd van echte personen, worden om die reden ingezet door cybercriminelen in activiteiten van social engineering.

Verschil in lichtreflectie

Onderzoekers van de Universiteit van Hull hebben nu toch een manier gevonden om het bedrog te herkennen. Deze methode kijkt naar het licht dat in de ogen van de afgebeelde personen gereflecteerd wordt. Dezelfde methode zetten onderzoekers ook in voor het bestuderen van sterrenstelsels.

Het principe gaat uit van de natuurlijke reflectie van licht in de ogen. Daarbij zal de lichtreflectie in ieder oog van dezelfde vorm zijn. De onderzoekers kwam erop uit dat AI daar geen rekening mee houdt, waardoor de lichtreflectie vaak een verschillende vorm aanneemt in ieder afzonderlijk oog.

Voor het onderzoek werd een automatische tool ontwikkeld die nagaat of de reflectie in de ogen al dan niet natuurlijk is. Het resultaat van de test is een Gini-score, waarbij een score richting nul een natuurlijk reflectie aantoont en een score richting één bedrog zou kunnen zijn.

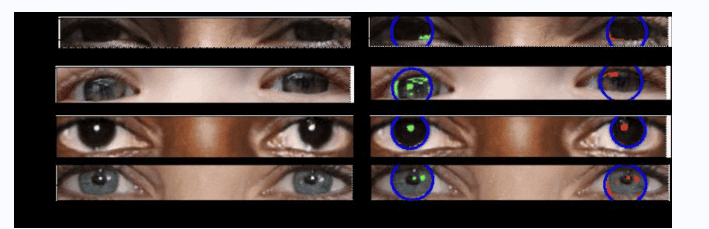

Deze afbeeldingen werden door AI gemaakt. De lichtreflectie in de ogen volgt niet hetzelfde patroon in het linker- en rechteroog. Bron: Adejumoke Owolabi

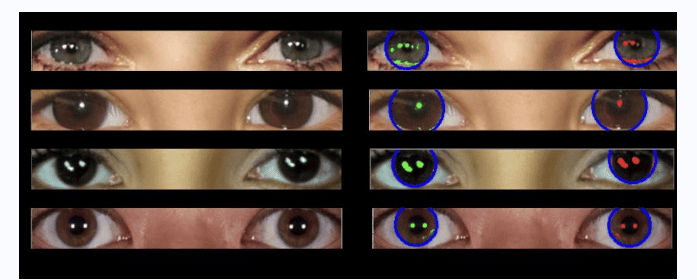

Dit zijn foto’s van echte personen. Er is duidelijk eenzelfde patroon van lichtreflectie in beide ogen. Bron: Adejumoke Owolabi

Basis voor verdere verbetering

De gepresenteerde methode is niet volledig nauwkeurig en kan vals positieve of vals negatieve resultaten opleveren. Daarnaast zitten er limieten aan de methode, doordat er een duidelijke close-up van de ogen nodig is.

AI-beeldgeneratoren kunnen het onderzoek tevens gebruiken om afbeeldingen realistischer te maken. Onderzoekers kunnen het onderzoek dan weer gebruiken om verder te reflecteren over detectietools. Daar is momenteel nog maar een zeer beperkt aanbod van beschikbaar, vaak met beperkingen.

Lees ook: Fraude met deepfakes: hoe kan een organisatie zich beschermen?